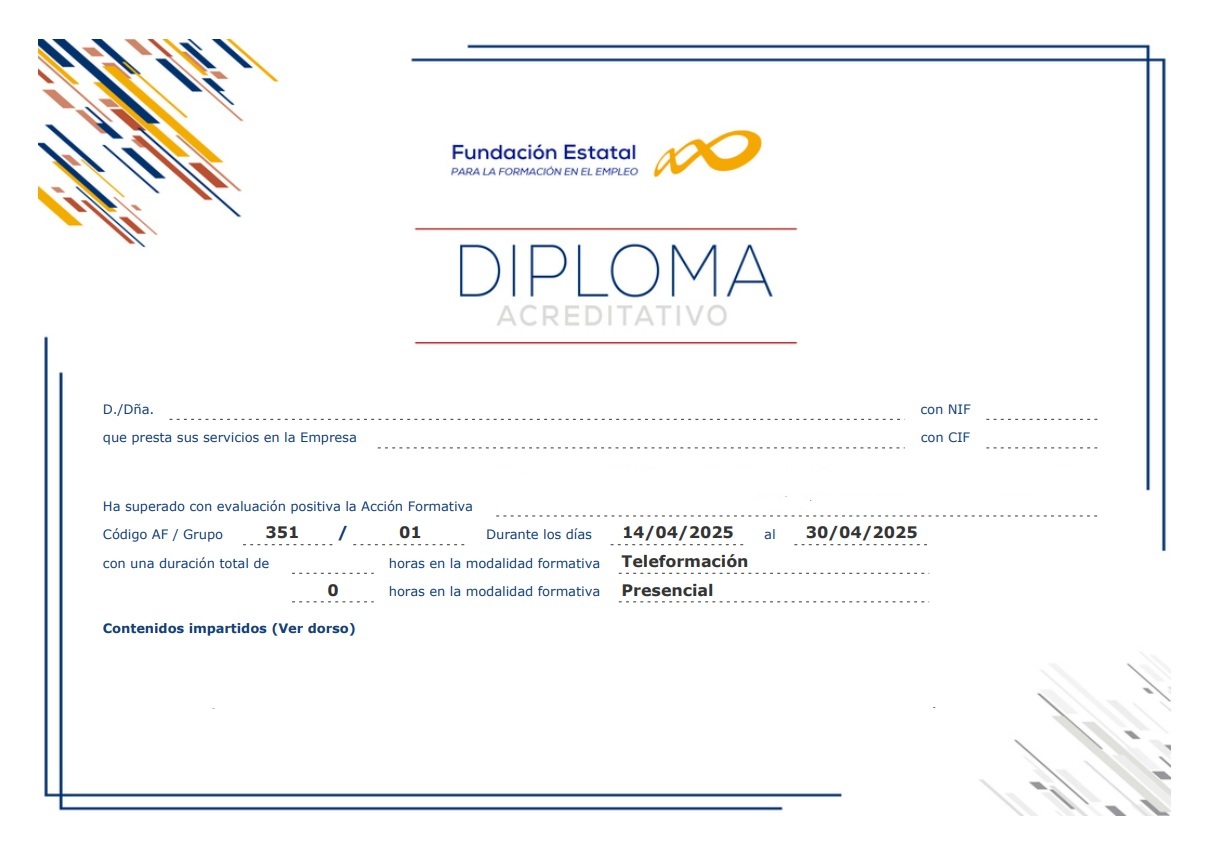

Diploma emitido por FUNDAE

+ Ampliar

+ Ampliar

🔍 Buscar curso

+5.000 cursos disponibles

Calendario: Flexible.

Calendario: Flexible.

Fecha disponible: Inmediata.

Fecha disponible: Inmediata.

Porcentaje de Bonificación: 100%

Porcentaje de Bonificación: 100%

Diploma acreditativo emitido por FUNDAE.

Diploma acreditativo emitido por FUNDAE.

Certificado acreditativo para concursos y oposiciones.

Certificado acreditativo para concursos y oposiciones.

Temario Personalizado.

Temario Personalizado.

Modalidades: teleformación, aula virtual y MIXTA

Modalidades: teleformación, aula virtual y MIXTA

| La duración del curso de XLNET Para Principiantes es de 40 horas,

acreditadas en el Diploma del mismo. PLAZO DE REALIZACIÓN: El plazo se puede establecer según las necesidades del alumno o del plan de formación de la empresa. |

| Este curso puede ser bonificado al 100% para la empresa receptora, incluso aunque esta tenga un porcentaje de copago en razón de su número de empleados en plantilla. El coste de la formación se recuperará

mediante descuento en el pago de los seguros sociales. |

Este descuento será aplicable libremente en cualquier mes del año posterior a la fecha en que haya finalizado la formación. Podrán bonificarse las matrículas de aquellos alumnos que realicen al menos el

75% del curso con éxito. |

| EN CURSOS ONLINE Teleformación: En esta modalidad todo el curso se realiza a través de internet, con acceso las 24 hs. todos los días de la semana y plazo máximo de seis meses. No hay actividades como clases a las que el alumno deba asistir en horarios y fechas programados. Aula virtual: En esta modalidad la formación se imparte mediante clases en directo a través de internet, es decir clases tele-presenciales, que se llevarán a cabo a través de ZOOM, Skype u otra herramienta a convenir. Modalidad MIXTA: Combinación de las dos modalidades anteriores. Los trabajadores asisten a clases en directo (por ejemplo una a la semana) y entre clases disponen de material para avanzar en el curso en la plataforma. Es la más completa para grupos de trabajadores que realizan un mismo curso. EN CURSOS PRESENCIALES o SEMI - PRESENCIALES En esta modalidad los trabajadores realizan el curso asistiendo físicamente a un aula en la que se imparte la formación. Puede ser complementada igualmente con acceso a una plataforma online entre clases. Para esta modalidad se requiere una consulta previa de disponibilidad en la ciudad donde se desee llevar a cabo. |

NOTA:

Trabajamos con la metodologia de curso personalizado, creada por Ciberaula en 1997. Usted puede solicitar un curso a la medida de sus objetivos, que combine lecciones de 2 o mas cursos en un plan de formacion a su medida. Si este es su caso consultenos, esta metodologia ofrece un aprovechamiento maximo de la formacion en los cursos bonificados para trabajadores.

El temario predefinido del curso online de XLNET Para Principiantes es el siguiente:

1 Introducción a XLNet y sus aplicaciones

1.1 ¿Qué es XLNet?

1.2 Aplicaciones de XLNet en el procesamiento de lenguaje natural

2 Preparación de datos para XLNet

2.1 Preprocesamiento de texto

2.2 Tokenización de texto

2.3 Generación de datos de entrenamiento y validación

3 Modelado de XLNet

3.1 Arquitectura del modelo XLNet

3.2 Entrenamiento y ajuste de hiperparámetros

4 Evaluar y mejorar el modelo

4.1 Medición del rendimiento del modelo

4.2 Métodos para mejorar el rendimiento del modelo

5 Transferencia de conocimiento

5.1 Conceptos de transferencia de aprendizaje

5.2 Transferencia de conocimiento en el procesamiento de lenguaje natural

6 XLNet en la clasificación de texto

6.1 Clasificación binaria y multiclase

6.2 Ejemplos de clasificación de texto con XLNet

7 XLNet en la generación de texto

7.1 Generación de texto utilizando XLNet

7.2 Ejemplos de generación de texto con XLNet

8 XLNet en la traducción de idiomas

8.1 Introducción a la traducción de idiomas

8.2 Uso de XLNet en la traducción de idiomas

9 XLNet en la generación de respuestas de diálogo

9.1 Generación de respuestas de diálogo utilizando XLNet

9.2 Ejemplos de generación de respuestas de diálogo con XLNet

10 Aplicaciones de XLNet en el mundo real

10.1 Implementación de XLNet en aplicaciones empresariales

10.2 Casos de uso de XLNet en la vida real

pip install transformers). Gratuita y de código abierto.pip install torch) o TensorFlow. Ambos gratuitos. PyTorch es la opción más habitual con XLNet.datasets, scikit-learn, pandas, numpy. Todas gratuitas via pip.Estos son los proyectos que desarrollarás a lo largo del curso. Cada uno reproduce un problema real que se resuelve con XLNet en entornos profesionales.

Estos son los tropiezos más frecuentes al empezar con XLNet. Conocerlos de antemano te ahorra horas de depuración.

AutoTokenizer sin especificar el modelo correcto (xlnet-base-cased) genera tokens incompatibles con el modelo y resultados sin sentido.padding_side: A diferencia de BERT, XLNet aplica padding por la izquierda. Si configuras padding por la derecha como en otros modelos, el rendimiento cae de forma silenciosa sin lanzar error.max_length y truncation=True en el tokenizador, obtendrás errores de memoria en secuencias extensas.TRANSFORMERS_CACHE), el modelo se descarga de nuevo cada vez, consumiendo tiempo y datos innecesariamente.Recursos gratuitos para complementar el curso, practicar fuera de él y mantenerte al día en NLP y modelos Transformer.

from transformers import XLNetTokenizer, XLNetForSequenceClassification — importación base para clasificación.tokenizer = XLNetTokenizer.from_pretrained('xlnet-base-cased') — carga el tokenizador oficial.Shift+Enter en Jupyter para ejecutar celda y avanzar. Ctrl+Shift+P en VS Code para abrir la paleta de comandos.pip install datasets): acceso a miles de datasets de NLP listos para usar con XLNet.huggingface-transformers y xlnet: solución rápida a errores concretos de código.

Formación bonificada online para empresas. Ayudamos a equipos a ganar productividad con formación realmente aprovechable.

Somos una empresa de formación bonificada especializada en formación online en sus diferentes modalidades: teleformación, aula virtual y formación mixta.

Ayudamos a nuestros clientes a alcanzar una mayor productividad mediante acciones formativas ajustadas a sus necesidades reales.

Formación que transforma equipos. Nos esforzamos por aportar valor: diseñamos itinerarios con objetivos concretos de negocio, medimos la finalización real, y acompañamos a cada alumno hasta el final. Por eso el 95% de quienes empiezan, terminan.