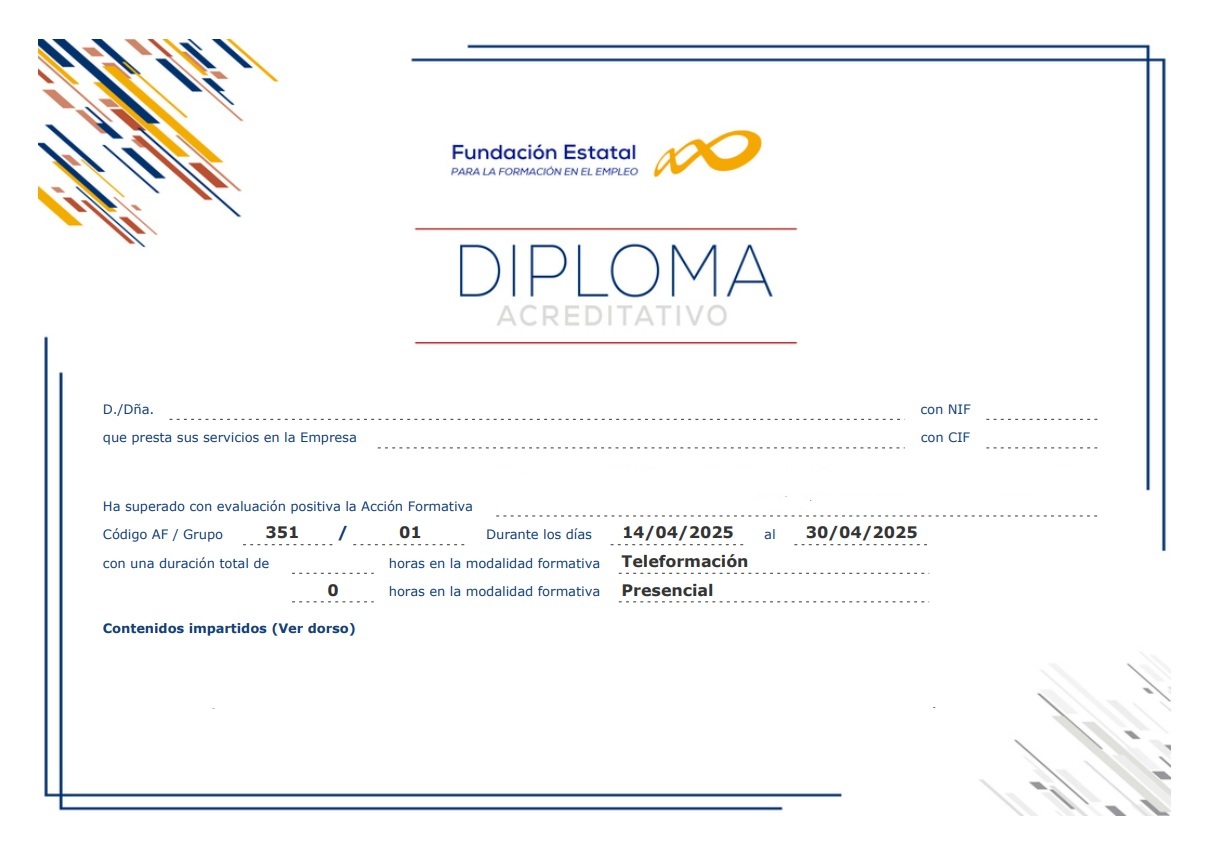

Diploma emitido por FUNDAE

+ Ampliar

+ Ampliar

🔍 Buscar curso

+5.000 cursos disponibles

Calendario: Flexible.

Calendario: Flexible.

Fecha disponible: Inmediata.

Fecha disponible: Inmediata.

Porcentaje de Bonificación: 100%

Porcentaje de Bonificación: 100%

Diploma acreditativo emitido por FUNDAE.

Diploma acreditativo emitido por FUNDAE.

Certificado acreditativo para concursos y oposiciones.

Certificado acreditativo para concursos y oposiciones.

Temario Personalizado.

Temario Personalizado.

Modalidades: teleformación, aula virtual y MIXTA

Modalidades: teleformación, aula virtual y MIXTA

| La duración del curso de DialoGPT Nivel Intermedio es de 40 horas,

acreditadas en el Diploma del mismo. PLAZO DE REALIZACIÓN: El plazo se puede establecer según las necesidades del alumno o del plan de formación de la empresa. |

| Este curso puede ser bonificado al 100% para la empresa receptora, incluso aunque esta tenga un porcentaje de copago en razón de su número de empleados en plantilla. El coste de la formación se recuperará

mediante descuento en el pago de los seguros sociales. |

Este descuento será aplicable libremente en cualquier mes del año posterior a la fecha en que haya finalizado la formación. Podrán bonificarse las matrículas de aquellos alumnos que realicen al menos el

75% del curso con éxito. |

| EN CURSOS ONLINE Teleformación: En esta modalidad todo el curso se realiza a través de internet, con acceso las 24 hs. todos los días de la semana y plazo máximo de seis meses. No hay actividades como clases a las que el alumno deba asistir en horarios y fechas programados. Aula virtual: En esta modalidad la formación se imparte mediante clases en directo a través de internet, es decir clases tele-presenciales, que se llevarán a cabo a través de ZOOM, Skype u otra herramienta a convenir. Modalidad MIXTA: Combinación de las dos modalidades anteriores. Los trabajadores asisten a clases en directo (por ejemplo una a la semana) y entre clases disponen de material para avanzar en el curso en la plataforma. Es la más completa para grupos de trabajadores que realizan un mismo curso. EN CURSOS PRESENCIALES o SEMI - PRESENCIALES En esta modalidad los trabajadores realizan el curso asistiendo físicamente a un aula en la que se imparte la formación. Puede ser complementada igualmente con acceso a una plataforma online entre clases. Para esta modalidad se requiere una consulta previa de disponibilidad en la ciudad donde se desee llevar a cabo. |

NOTA:

Trabajamos con la metodologia de curso personalizado, creada por Ciberaula en 1997. Usted puede solicitar un curso a la medida de sus objetivos, que combine lecciones de 2 o mas cursos en un plan de formacion a su medida. Si este es su caso consultenos, esta metodologia ofrece un aprovechamiento maximo de la formacion en los cursos bonificados para trabajadores.

El temario predefinido del curso online de DialoGPT Nivel Intermedio es el siguiente:

1 Repaso de los conceptos básicos de DialoGPT

1.1 Revisión de la arquitectura y funcionamiento de DialoGPT

1.2 Uso de herramientas de programación para trabajar con DialoGPT

2 Preparación de los datos

2.1 Técnicas de limpieza de datos

2.2 Métodos de tokenización y separación de oraciones

2.3 Estrategias para el equilibrio del conjunto de datos

3 Procesamiento de lenguaje natural (NLP) para DialoGPT

3.1 Introducción a NLP

3.2 Procesamiento de texto con NLP

3.3 Análisis de sentimientos y opiniones

4 Entrenamiento de modelos de diálogo

4.1 Ajuste de hiperparámetros

4.2 Métodos de entrenamiento avanzados

4.3 Ajuste fino para mejorar la calidad de las respuestas

5 Evaluación de los modelos de diálogo

5.1 Métricas de evaluación de modelos de diálogo

5.2 Pruebas de calidad del modelo y evaluación de errores comunes

6 Generación de texto con DialoGPT

6.1 Generación de texto coherente y fluido

6.2 Uso de la puntuación y la estructura del texto para mejorar la calidad de la respuesta

7 Mejora de la calidad de las respuestas

7.1 Técnicas de modelado de contexto

7.2 Análisis de las respuestas del modelo y ajuste para mejorar la coherencia

8 Implementación de DialoGPT en aplicaciones empresariales

8.1 Integración de DialoGPT con API RESTful

8.2 Despliegue de DialoGPT en la nube

9 Uso de DialoGPT para resolver problemas del mundo real

9.1 Estudios de casos empresariales

9.2 Selección del modelo adecuado y adaptación para aplicaciones específicas

10 Técnicas avanzadas de modelos de diálogo

10.1 Revisión de los últimos avances en modelos de diálogo

10.2 Análisis comparativo de DialoGPT con otros modelos de diálogo avanzados

Durante el curso construyes sistemas conversacionales reales, desde la limpieza de datos hasta el despliegue en la nube. Estos son los proyectos principales que desarrollarás:

Estos son los errores más frecuentes al trabajar con DialoGPT a nivel intermedio. Identificarlos antes de que te ocurran te ahorrará horas de depuración.

eos_token_id y pad_token_id correctamente, el modelo genera texto infinito o lanza errores en batch inference.save_pretrained() cada N pasos, un corte de sesión en Colab o un crash implica empezar el fine-tuning desde cero.Recursos gratuitos y comunidades que usarás durante el curso y que te seguirán siendo útiles después.

model.generate(input_ids, max_length=200, do_sample=True, top_p=0.95) — generación con muestreo nucleus para respuestas más variadastrainer.train(resume_from_checkpoint=True) — reanudar fine-tuning desde el último checkpoint guardadotokenizer.apply_chat_template() — formateo correcto de turnos de conversación en modelos recientes de Hugging FaceShift+Tab para ver la firma de cualquier función, %%time para medir cuánto tarda una celdaArtículos publicados sobre DialoGPT Nivel Intermedio

|

Por Ana María González

DialoGPT y la Transformación de la Comunicación Empresarial en 2025 La inteligencia artificial conversacional se ha convertido en una herramienta imprescindible para empresas de todos los tamaños en 2025. Plataformas como DialoGPT permiten automatizar interacciones, mejorar la atención al cliente y generar contenidos de manera eficiente, abriendo nuevas oportunidades para negocios digitales y PYMES que buscan optimizar recursos y aumentar su competitividad. Gracias a la implementación de modelos de lenguaje natural y técnicas de entrenamiento de IA, las empresas pueden crear asistentes virtuales capaces de comprender y responder consultas complejas, gestionar procesos internos y ofrecer soporte personalizado. Esta tecnología permite reducir tiempos de respuesta, disminuir errores humanos y mejorar la experiencia de usuario de manera significativa. Además, la utilización de DialoGPT en la generación de contenido y automatización de mensajes estratégicos se ha convertido en una tendencia creciente para sectores como ecommerce, servicios financieros y marketing digital. Los prompts inteligentes permiten adaptar el lenguaje a cada cliente, mejorando la personalización y aumentando la eficacia de las campañas y procesos internos. En la práctica, negocios de Madrid y otras ciudades españolas ya están aprovechando estas soluciones para optimizar la atención en tiendas online, gestionar consultas frecuentes y automatizar reportes internos. El procesamiento de lenguaje natural no solo incrementa la productividad, sino que también genera insights valiosos para la toma de decisiones, posicionando a las empresas que lo adoptan a la vanguardia tecnológica del 2025. |

|---|

Formación bonificada online para empresas. Ayudamos a equipos a ganar productividad con formación realmente aprovechable.

Somos una empresa de formación bonificada especializada en formación online en sus diferentes modalidades: teleformación, aula virtual y formación mixta.

Ayudamos a nuestros clientes a alcanzar una mayor productividad mediante acciones formativas ajustadas a sus necesidades reales.

Formación que transforma equipos. Nos esforzamos por aportar valor: diseñamos itinerarios con objetivos concretos de negocio, medimos la finalización real, y acompañamos a cada alumno hasta el final. Por eso el 95% de quienes empiezan, terminan.