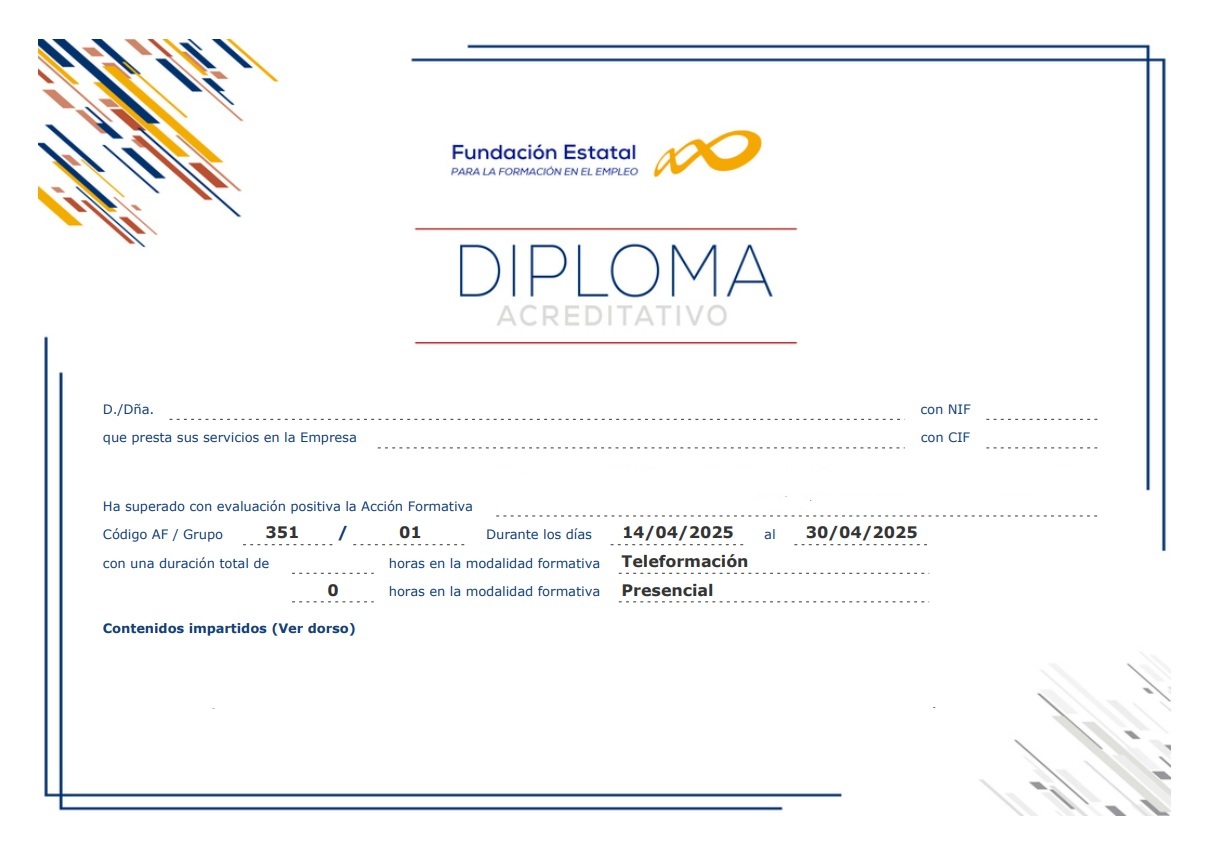

Diploma emitido por FUNDAE

+ Ampliar

+ Ampliar

🔍 Buscar curso

+5.000 cursos disponibles

Calendario: Flexible.

Calendario: Flexible.

Fecha disponible: Inmediata.

Fecha disponible: Inmediata.

Porcentaje de Bonificación: 100%

Porcentaje de Bonificación: 100%

Diploma acreditativo emitido por FUNDAE.

Diploma acreditativo emitido por FUNDAE.

Certificado acreditativo para concursos y oposiciones.

Certificado acreditativo para concursos y oposiciones.

Temario Personalizado.

Temario Personalizado.

Modalidades: teleformación, aula virtual y MIXTA

Modalidades: teleformación, aula virtual y MIXTA

| La duración del curso de Google Gemini en empresas y profesionales es de 50 horas,

acreditadas en el Diploma del mismo. PLAZO DE REALIZACIÓN: El plazo se puede establecer según las necesidades del alumno o del plan de formación de la empresa. |

| Este curso puede ser bonificado al 100% para la empresa receptora, incluso aunque esta tenga un porcentaje de copago en razón de su número de empleados en plantilla. El coste de la formación se recuperará

mediante descuento en el pago de los seguros sociales. |

Este descuento será aplicable libremente en cualquier mes del año posterior a la fecha en que haya finalizado la formación. Podrán bonificarse las matrículas de aquellos alumnos que realicen al menos el

75% del curso con éxito. |

| EN CURSOS ONLINE Teleformación: En esta modalidad todo el curso se realiza a través de internet, con acceso las 24 hs. todos los días de la semana y plazo máximo de seis meses. No hay actividades como clases a las que el alumno deba asistir en horarios y fechas programados. Aula virtual: En esta modalidad la formación se imparte mediante clases en directo a través de internet, es decir clases tele-presenciales, que se llevarán a cabo a través de ZOOM, Skype u otra herramienta a convenir. Modalidad MIXTA: Combinación de las dos modalidades anteriores. Los trabajadores asisten a clases en directo (por ejemplo una a la semana) y entre clases disponen de material para avanzar en el curso en la plataforma. Es la más completa para grupos de trabajadores que realizan un mismo curso. EN CURSOS PRESENCIALES o SEMI - PRESENCIALES En esta modalidad los trabajadores realizan el curso asistiendo físicamente a un aula en la que se imparte la formación. Puede ser complementada igualmente con acceso a una plataforma online entre clases. Para esta modalidad se requiere una consulta previa de disponibilidad en la ciudad donde se desee llevar a cabo. |

NOTA:

Trabajamos con la metodologia de curso personalizado, creada por Ciberaula en 1997. Usted puede solicitar un curso a la medida de sus objetivos, que combine lecciones de 2 o mas cursos en un plan de formacion a su medida. Si este es su caso consultenos, esta metodologia ofrece un aprovechamiento maximo de la formacion en los cursos bonificados para trabajadores.

El temario predefinido del curso online de Google Gemini en empresas y profesionales es el siguiente:

1 Introducción a la familia Gemini

1.1 Qué es Gemini y por qué importa en 2026

1.2 Historia: de Bard a Gemini, de Gemini 1 a Gemini 3

1.3 La familia actual: Pro, Flash, Flash-Lite, Deep Think

1.4 Multimodalidad nativa: texto, imagen, audio y vídeo

1.5 Posicionamiento frente a GPT, Claude y Llama

2 La app Gemini para profesionales

2.1 Acceso, registro y planes (Free, AI Pro, AI Ultra)

2.2 La interfaz: chat, Gems, Canvas y NotebookLM

2.3 Selección de modelo: Fast vs Thinking en la app

2.4 Carga de archivos, imágenes y enlaces

2.5 Búsqueda integrada con AI Mode en Search

3 Trabajo diario con Gemini

3.1 Generación de texto: emails, propuestas, informes

3.2 Análisis de documentos largos con contexto extendido

3.3 Resumen y extracción de datos de PDF y vídeo

3.4 Traducción profesional y revisión de estilo

3.5 Reescritura adaptada a tono y audiencia

4 Prompts efectivos para Gemini

4.1 Anatomía de un prompt: rol, contexto, instrucción, formato, restricciones

4.2 Few-shot prompting con ejemplos estructurados

4.3 Chain-of-thought y razonamiento paso a paso

4.4 Limitaciones y alucinaciones: cómo detectarlas

4.5 Buenas prácticas frente a errores frecuentes

5 Gemini con imagen y vídeo

5.1 Análisis de imágenes: documentos, diagramas, fotografías

5.2 Generación con Nano Banana 2 (imagen rápida)

5.3 Nano Banana Pro: imágenes 4K para producción

5.4 Generación de vídeo con Veo 3.1

5.5 Casos de uso: marketing, formación interna, comunicación

6 Integración con Google Workspace

6.1 Gemini en Gmail: redacción y respuesta asistida

6.2 Gemini en Docs: borradores, revisión y resumen

6.3 Gemini en Sheets: análisis de datos y fórmulas

6.4 Gemini en Drive: búsqueda semántica de archivos

6.5 Gemini en Meet: notas y resumen de reuniones

7 Google AI Studio para no desarrolladores

7.1 Acceso y configuración inicial

7.2 Prueba comparativa de modelos

7.3 Ajuste de parámetros: temperatura, top-K, top-P

7.4 System instructions y configuraciones de seguridad

7.5 Exportar prompts a código

8 API Gemini con Python parte 1

8.1 Obtención de API key y primeros requests

8.2 Instalación del SDK google-genai

8.3 Llamada básica: generate_content

8.4 Streaming de respuestas

8.5 Conteo de tokens y control de costes

9 API Gemini con Python parte 2

9.1 Mensajes multimodales: texto + imagen

9.2 Procesamiento de audio y vídeo vía API

9.3 Function calling y tool use

9.4 Búsqueda en Google integrada (grounding)

9.5 JSON mode y respuestas estructuradas

10 API Gemini con Node.js

10.1 SDK oficial de Google para JavaScript

10.2 Integración en aplicaciones Express y Next.js

10.3 Llamadas asíncronas y manejo de errores

10.4 Streaming en interfaces web

10.5 Despliegue en Vercel y Cloud Run

11 Vertex AI para empresas

11.1 Diferencias entre AI Studio y Vertex AI

11.2 Acceso desde Google Cloud Console

11.3 Cuotas, regiones y residencia de datos

11.4 Gemini Enterprise: SLA y soporte corporativo

11.5 Integración con BigQuery y Cloud Storage

12 Agentes con Gemini

12.1 Qué es un agente y por qué Gemini 3 destaca

12.2 Tool calling avanzado con múltiples funciones

12.3 Agentes con memoria y planificación

12.4 Computer Use: agentes que controlan navegadores

12.5 Antigravity: plataforma de desarrollo agentic de Google

13 Casos de uso empresariales

13.1 Atención al cliente con chatbot Gemini

13.2 Análisis de contratos y documentación legal

13.3 Generación de contenido para marketing

13.4 Asistente de programación con Gemini Code Assist

13.5 RAG corporativo: tu base de conocimiento + Gemini

14 Costes, planes y selección de modelo

14.1 Pricing de Gemini API por modelo

14.2 Flex y Priority tiers: optimización de coste

14.3 Comparativa Pro vs Flash vs Flash-Lite

14.4 Cuándo usar cada modelo según tarea

14.5 Caching de contexto para reducir factura

15 Gemini frente a la competencia

15.1 Comparativa con ChatGPT y GPT-5.5

15.2 Comparativa con Claude Opus y Sonnet

15.3 Comparativa con DeepSeek y Llama

15.4 Benchmarks reales: ARC-AGI-2, GPQA, SWE-Bench

15.5 Estrategia multi-modelo en empresa

16 Privacidad, seguridad y gobierno del dato

16.1 Política de Google sobre datos del usuario

16.2 Diferencia entre Gemini app y Gemini Enterprise

16.3 RGPD UE 2016/679 y datos personales en prompts

16.4 LO 3/2018 y obligaciones del responsable del tratamiento

16.5 Anonimización antes del envío a la API

17 Reglamento UE de IA y modelos GPAI

17.1 Reglamento UE 2024/1689 (AI Act): visión general

17.2 Modelos de propósito general (GPAI): obligaciones desde agosto 2025

17.3 Transparencia: Art. 50 y etiquetado de contenido sintético

17.4 Sistemas de alto riesgo: Anexo III y obligaciones desde agosto 2026

17.5 Alfabetización IA en plantilla: Art. 4

18 Limitaciones y errores frecuentes

18.1 Alucinaciones: detección y mitigación

18.2 Sesgos en respuestas y mitigaciones

18.3 Verificación de hechos contra fuentes primarias

18.4 Ventana de contexto: cuándo lo largo perjudica

18.5 Cuándo NO usar Gemini

19 Productividad medible con Gemini

19.1 Métricas: ahorro de tiempo por tarea

19.2 Casos reales: marketing, ventas, RR. HH., legal

19.3 ROI: del piloto al despliegue corporativo

19.4 Formación interna y change management

19.5 Política de uso responsable en empresa

20 Proyecto final

20.1 Definición de un caso de uso real

20.2 Diseño de prompts y selección de modelo

20.3 Implementación con API o app

20.4 Evaluación de resultados y costes

20.5 Documentación y plan de despliegue

A lo largo del curso construirás aplicaciones y soluciones reales usando Gemini y sus APIs, no solo ejercicios teóricos. Estos son los proyectos principales que desarrollarás:

Estos son los errores más frecuentes cuando se empieza a trabajar con Gemini y su API. Reconocerlos antes te ahorra horas de frustración:

Estos recursos complementan el curso y te serán útiles tanto mientras estudias como después, en proyectos reales:

Artículos publicados sobre Google Gemini en empresas y profesionales

|

Por Jasmin Fasquelle Casos de uso reales de Gemini en empresa: salud, finanzas, automoción y manufactura Google Gemini ha pasado de ser una promesa de laboratorio a un modelo desplegado en producción en sectores muy distintos. En salud, organizaciones como hospitales universitarios usan la familia Gemini 3 para resumir historiales clínicos largos aprovechando la ventana de 1 millón de tokens, extraer datos estructurados de informes y analizar imagen radiológica como apoyo al diagnóstico, siempre con un médico revisando el resultado y bajo supervisión humana exigida por el AI Act para sistemas de alto riesgo (Anexo III). En finanzas, los equipos de análisis usan Gemini con function calling para construir agentes que combinan datos de mercado, noticias en tiempo real con grounding de Google Search y modelos internos de riesgo, todo dentro del entorno controlado de Vertex AI con residencia de datos en regiones europeas. En el sector automotriz, Gemini se aplica al procesamiento multimodal de datos de sensores y vídeo para asistencia a la conducción y al análisis de garantías a partir de fotografías y descripciones de avería. Por último, en manufactura, las empresas integran Gemini en sus paneles de planta para detectar anomalías en imágenes de inspección visual, generar instrucciones de trabajo a partir de manuales técnicos y resumir reuniones operativas en varios idiomas. El denominador común en todos estos casos es el mismo: tareas con contexto largo y multimodal donde el modelo aporta valor medible cuando se combina con datos propios de la empresa y un proceso humano de revisión, no como sustituto del experto. |

|---|

|

Por Jasmin Fasquelle Cómo integrar Gemini en tu stack: Workspace, Vertex AI, API y conectores

El punto de entrada a Gemini depende del perfil del usuario. Para uso final hay tres canales que no requieren programación: la app Gemini con sus modos Fast y Thinking, AI Mode en Search para preguntas conversacionales con resultados grounded, y la integración nativa en Google Workspace (Gmail, Docs, Sheets, Drive, Meet) que permite redactar correos, resumir documentos y reuniones, o analizar tablas con un solo clic. Para perfiles técnicos hay dos plataformas. Google AI Studio es el entorno de prototipado: prueba rápida de modelos, ajuste de parámetros (temperatura, top-K, top-P), system instructions y exportación directa a código Python o Node.js. Vertex AI es el equivalente para producción empresarial: SLA, residencia de datos, integración con BigQuery y Cloud Storage, y la marca Gemini Enterprise que garantiza por contrato que los datos del cliente no se usan para entrenamiento. A nivel de integración técnica destaca el function calling avanzado de Gemini 3, que permite construir agentes que invocan APIs internas con fiabilidad, el soporte oficial de la herramienta Computer Use en gemini-3-pro-preview y gemini-3-flash-preview para agentes que controlan navegadores, y la nueva plataforma Antigravity de Google para desarrollo agentic. Para empresas con datos sensibles, el patrón habitual es RAG corporativo: tu base de conocimiento indexada + Gemini como motor de razonamiento, sin que la información salga de tu Cloud privado. |

|---|

|

Por Jasmin Fasquelle Seguridad, privacidad y RGPD: Gemini app vs Gemini Enterprise La diferencia más importante para una empresa europea entre Gemini app (consumo) y Gemini Enterprise (corporativo) está en el tratamiento de datos. En la app de consumo, las conversaciones pueden ser revisadas por humanos y usadas para mejorar los modelos salvo que el usuario lo desactive expresamente. En Gemini Enterprise, contratado a través de Vertex AI o Workspace Enterprise, Google se compromete por contrato a no usar los datos del cliente para entrenamiento, ofrece logs de auditoría y permite elegir residencia europea. Para cumplir con el RGPD UE 2016/679 y la LO 3/2018, la regla práctica es no enviar a la app pública datos personales identificables ni información confidencial de empresa. La anonimización previa de los prompts (sustituir nombres, DNI, emails y números de cuenta por placeholders antes de enviar) es una práctica recomendada incluso en Gemini Enterprise. Conviene además mantener un registro de actividades de tratamiento que documente qué datos se procesan con IA y con qué finalidad. A nivel regulatorio, los modelos de propósito general como Gemini 3 entran en el Reglamento UE 2024/1689 (AI Act). Las obligaciones para proveedores GPAI están en vigor desde agosto de 2025; las obligaciones de transparencia del Art. 50 (etiquetado obligatorio de contenido sintético generado con IA, incluido vídeo Veo y imágenes Nano Banana) se aplican desde agosto de 2026. Para empresas que usen Gemini en sistemas de alto riesgo (Anexo III: empleo, crédito, educación, sanidad), es obligatoria una evaluación previa de conformidad y supervisión humana documentada. |

|---|

|

Por Jasmin Fasquelle Comparativa Gemini 3.1 Pro vs 3 Flash vs 3 Deep Think: cuándo usar cada uno

Gemini 3.1 Pro es el modelo de máxima capacidad de la familia en mayo de 2026. Alcanza un 77,1% en ARC-AGI-2 según la propia ficha publicada por Google DeepMind, más del doble que la generación 2.5, y es la opción cuando la tarea requiere razonamiento profundo: análisis de contratos largos, investigación, debugging de código complejo, planificación agentic multi-paso. Tiene la ventana de 1 millón de tokens y latencia más alta que las variantes Flash. Gemini 3 Flash, lanzado el 22 de abril de 2026, es el modelo por defecto de la app Gemini y de AI Mode en Search. Aporta razonamiento de calidad casi Pro a velocidad y coste mucho menores. Es la elección óptima para chatbots de atención al cliente, análisis ligero de documentos, generación de contenido a escala y agentes que necesitan latencia baja. Gemini 3 Flash-Lite está pensado para volumen muy alto y tareas más simples donde el coste por token es el factor crítico. Gemini 3 Deep Think es el modo de razonamiento extendido pensado para retos científicos, matemáticos y de ingeniería donde el tiempo de respuesta no importa pero la calidad del razonamiento sí. Disponible para suscriptores de Google AI Ultra, complementa a Pro en problemas que requieren múltiples cadenas de razonamiento. La estrategia multi-modelo habitual en empresa es usar Pro para tareas críticas, Flash para producción a escala y Flash-Lite para casos de altísimo volumen, eligiendo siempre el modelo más barato que cumpla calidad. |

|---|

|

Por Mario Madrid Introducción a la familia Gemini en 2026: del Bard original a Gemini 3.1

Gemini es la familia de modelos de inteligencia artificial multimodal desarrollada por Google DeepMind, sucesora de PaLM 2 y del chatbot original Bard. La marca Bard se renombró a Gemini en 2024 para unificar bajo un mismo nombre el modelo y la app que lo expone. Desde entonces el ritmo de versiones ha sido vertiginoso: Gemini 1, Gemini 2, Gemini 2.5, Gemini 3 (noviembre 2025) y Gemini 3.1 Pro (marzo 2026), cada generación con sub-variantes Pro, Flash y Flash-Lite además de modelos especializados.

La familia actual cubre un espectro amplio. Gemini 3.1 Pro es el cerebro: razonamiento profundo, 1M de tokens de contexto y Computer Use para agentes. Gemini 3 Flash entrega calidad casi Pro a baja latencia y coste. Nano Banana 2 (Gemini 3.1 Flash Image, febrero 2026) y Nano Banana Pro (Gemini 3 Pro Image, noviembre 2025) generan y editan imagen, esta última a 4K para producción profesional. Veo 3.1 y Veo 3.1 Lite generan vídeo con audio sincronizado. Y Gemini 3 Deep Think aporta razonamiento extendido para problemas científicos.

Para una empresa o profesional español que se incorpora ahora, la ruta razonable es esta: empezar usando la app Gemini y la integración con Workspace para identificar dónde aporta valor, prototipar después casos concretos en Google AI Studio, y migrar las cargas de trabajo críticas a Vertex AI o Gemini Enterprise cuando se confirme el ROI. La barrera de entrada técnica es baja: la API se invoca con pocas líneas de Python o Node.js. La barrera real es la organizativa: definir casos de uso, asegurar cumplimiento RGPD y AI Act, y formar al equipo. |

|---|

📰 Blog del curso

Formación bonificada online para empresas. Ayudamos a equipos a ganar productividad con formación realmente aprovechable.

Somos una empresa de formación bonificada especializada en formación online en sus diferentes modalidades: teleformación, aula virtual y formación mixta.

Ayudamos a nuestros clientes a alcanzar una mayor productividad mediante acciones formativas ajustadas a sus necesidades reales.

Formación que transforma equipos. Nos esforzamos por aportar valor: diseñamos itinerarios con objetivos concretos de negocio, medimos la finalización real, y acompañamos a cada alumno hasta el final. Por eso el 95% de quienes empiezan, terminan.