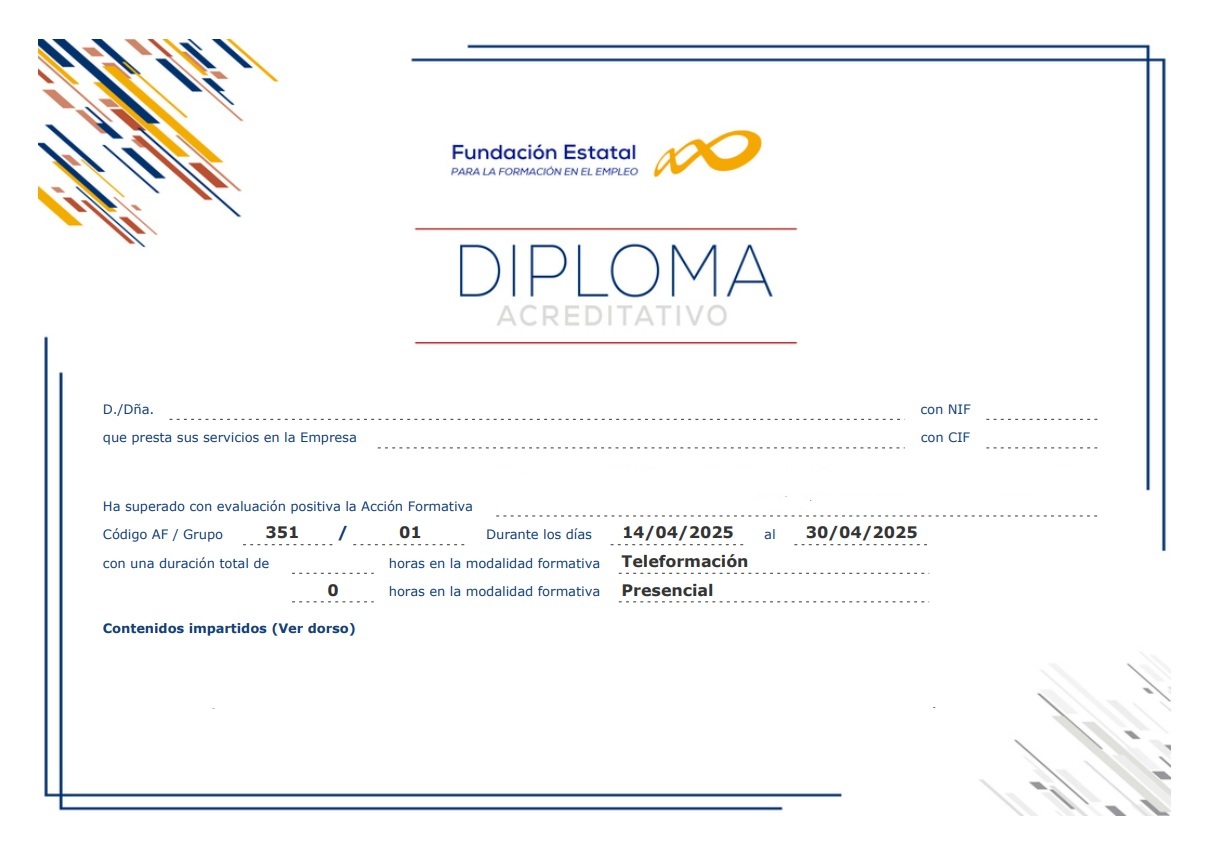

Diploma emitido por FUNDAE

+ Ampliar

+ Ampliar

🔍 Buscar curso

+5.000 cursos disponibles

Calendario: Flexible.

Calendario: Flexible.

Fecha disponible: Inmediata.

Fecha disponible: Inmediata.

Porcentaje de Bonificación: 100%

Porcentaje de Bonificación: 100%

Diploma acreditativo emitido por FUNDAE.

Diploma acreditativo emitido por FUNDAE.

Certificado acreditativo para concursos y oposiciones.

Certificado acreditativo para concursos y oposiciones.

Temario Personalizado.

Temario Personalizado.

Modalidades: teleformación, aula virtual y MIXTA

Modalidades: teleformación, aula virtual y MIXTA

| La duración del curso de DeepSeek Domina la herramienta de cero a producción es de 40 horas,

acreditadas en el Diploma del mismo. PLAZO DE REALIZACIÓN: El plazo se puede establecer según las necesidades del alumno o del plan de formación de la empresa. |

| Este curso puede ser bonificado al 100% para la empresa receptora, incluso aunque esta tenga un porcentaje de copago en razón de su número de empleados en plantilla. El coste de la formación se recuperará

mediante descuento en el pago de los seguros sociales. |

Este descuento será aplicable libremente en cualquier mes del año posterior a la fecha en que haya finalizado la formación. Podrán bonificarse las matrículas de aquellos alumnos que realicen al menos el

75% del curso con éxito. |

| EN CURSOS ONLINE Teleformación: En esta modalidad todo el curso se realiza a través de internet, con acceso las 24 hs. todos los días de la semana y plazo máximo de seis meses. No hay actividades como clases a las que el alumno deba asistir en horarios y fechas programados. Aula virtual: En esta modalidad la formación se imparte mediante clases en directo a través de internet, es decir clases tele-presenciales, que se llevarán a cabo a través de ZOOM, Skype u otra herramienta a convenir. Modalidad MIXTA: Combinación de las dos modalidades anteriores. Los trabajadores asisten a clases en directo (por ejemplo una a la semana) y entre clases disponen de material para avanzar en el curso en la plataforma. Es la más completa para grupos de trabajadores que realizan un mismo curso. EN CURSOS PRESENCIALES o SEMI - PRESENCIALES En esta modalidad los trabajadores realizan el curso asistiendo físicamente a un aula en la que se imparte la formación. Puede ser complementada igualmente con acceso a una plataforma online entre clases. Para esta modalidad se requiere una consulta previa de disponibilidad en la ciudad donde se desee llevar a cabo. |

NOTA:

Trabajamos con la metodologia de curso personalizado, creada por Ciberaula en 1997. Usted puede solicitar un curso a la medida de sus objetivos, que combine lecciones de 2 o mas cursos en un plan de formacion a su medida. Si este es su caso consultenos, esta metodologia ofrece un aprovechamiento maximo de la formacion en los cursos bonificados para trabajadores.

El temario predefinido del curso online de DeepSeek Domina la herramienta de cero a producción es el siguiente:

1 Introducción al curso y a la Plataforma

1.1 Introducción al curso

1.2 Introducción a la Plataforma de Udemy

2 Introducción a DeepSeek

2.1 DeepSeek: un cambio de paradigma en el campo de la IA

2.2 El desafio del razonamiento en los Modelos de Lenguage (LLMs)

2.3 DeepSeek R1: El modelo más conocido de DeepSeek

2.4 Timeline y evolución de DeepSeek

2.5 Primeros pasos con DeepSeek Chat

2.6 Funcionalidad de razonamiento de DeepSeek R1

2.7 Funcionalidad de Busqueda en internet de DeepSeek

2.8 Multimodalidad en DeepSeek y reconocimiento de imagenes

3 Por qué DeepSeek es relevante

3.1 Impacto Global de DeepSeek y razones que justifican tal impacto

3.2 Chain-of-Thought para el razonamiento paso a paso

3.3 Aprendizaje por refuerzo y destilación de modelos

4 Caracteristicas de DeepSeek R1

4.1 Innovación Tecnologica de DeepSeek-R1

4.2 Características y limitaciones de DeepSeek R1

4.3 Razonamiento y Aha Moment propio de DeepSeek R1

4.4 Destilación: potenciando modelos más pequeños

4.5 Open-source, licencia MIT y costes reducidos

4.6 Benchmark de rendimiento y entornos edge

5 Herramientas Clave para acceder a DeepSeek

5.1 Diferentes Opciones de alojamiento y despliegue del modelo DeepSeek

5.2 Diferentes herramientas para integrar y desplegar DeepSeek

5.3 Plataformas para acceder a LLMs de manera fácil

5.4 Ollama y LM Studio para ejecutar DeepSeek en nuestro ordenador local

5.5 Hugging Face: el mayor repositorio de modelos Open-source del mundo

5.6 LangChain: la libreria para el desarrollo de aplicaciones empresariales con LLMs

5.7 Flowise: Desarrollo de aplicaciones con LLMs sin programar

6 Acceso a DeepSeek a través de API

6.1 API de DeepSeek y acceso al modelo

6.2 OpenRouter: la API unificada para acceder a LLMs como DeepSeek

6.3 Replicate: la plataforma para acceder fácilmente a LLMs

6.4 Ejecutando DeepSeek desde Replicate

6.5 TogetherAI: la plataforma fácil para acceder a LLMs como DeepSeek

7 Ollama: Modelos Open-Source en local

7.1 Ollama: La plataforma para ejecutar LLMs en local

7.2 Diferentes modelos Open-source disponibles en Ollama

7.3 Instalación y ejecución de Ollama

7.4 Instalando y ejecutando DeepSeek en local a través de Ollama

7.5 Interfaz visual para el modelo de DeepSeek en local

8 Funciones Clave de LangChain aplicadas a LLMs

8.1 Introducción a las Funciones Clave de LangChain

8.2 Casos de uso y componentes de LangChain

8.3 Diferentes tipos de modelos LangChain y requisitos

8.4 Gestión de entradas del LLM con el módulo de Prompts de LangChain

8.5 Combinación de LLMs con otros componentes a través de cadenas

8.6 Dando acceso a datos externos a través de Índices de LangChain

8.7 Dando la capacidad de memorizar a ChatGPT a través de Memory LangChain

8.8 Dando acceso a herramientas gracias al módulo de Agents de LangChain

9 Desarrollo de soluciones avanzadas con DeepSeek y LangChain

9.1 Instalación de librerías y configuración del entorno

9.2 ChatOllama: Función fácil para interactuar con el modelo de DeepSeek

9.3 PrompTemplate: Personalizando y formateando las instrucciones de DeepSeek

9.4 OutputParsers: Estructurando la salida del modelo de DeepSeek

9.5 Documents, DocumentLoaders y Text Splitters: accediendo a información

9.6 Dando acceso a DeepSeek a Documentos

9.7 ChatMessageHistory: Dando acceso al modelo al histórico de conversaciones

9.8 Desarrollo de Agentes con DeepSeek

9.9 Todo sobre las Cadenas: basic chains, sequential chains y summarization

10 Desarrollo de Aplicaciones avanzadas Sin Programar con DeepSeek

10.1 Introducción a Flowise: el entorno de aplicaciones con LLMs sin programar

10.2 Características de Flowise

10.3 Instalación de Flowise

10.4 Primeros pasos con Flowise

10.5 Acceso a DeepSeek desde Flowise

10.6 OpenRouter, Ollama y HuggingFace para acceder a DeepSeek desde Flowise

11 Modelos de Lenguage con Acceso a Información (RAGs)

11.1 Introducción a los LLM con Conocimiento (RAG)

11.2 Consideraciones importantes y aplicaciones reales de los RAG

11.3 Cómo se construye un RAG

11.4 Desarrollo de un RAG con DeepSeek y Flowise

12 Hugging Face: el mayor repositorio de modelos Open-Source

12.1 Introducción a Hugging Face

12.2 Componentes de Hugging Face

12.3 Plataforma de Hugging Face

12.4 Fundamentos de la librería de Transformers

12.5 Laboratorio Práctico de Hugging Face

12.6 Acceso al modelo de DeepSeek a través de HuggingFace

13 Desarrollo de Agentes con DeepSeek

13.1 Introducción a los Agentes

13.2 Diferentes tipos de Agentes

13.3 Laboratorio Práctico: Desarrollo de Conversational Agent, RAG y Multi-Agent

13.4 Function Calling e Integración con DeepSeek R1 para el desarrollo de Agentes

13.5 Alternativas para el desarrollo de un agente avanzado con DeepSeek

13.6 Laboratorio Práctico: Desarrollo de un agente con DeepSeek V3

13.7 Laboratorio Práctico: Desarrollo de un agente con DeepSeek R1 Tool Calling

A lo largo del curso construyes aplicaciones reales con DeepSeek, desde un chat local hasta agentes multi-herramienta desplegados en producción. Cada proyecto resuelve un caso de uso empresarial concreto.

Estos son los errores que cometen casi todos los alumnos al empezar con DeepSeek en entornos reales. Evítalos desde el primer día.

python -m venv venv antes de pip install..env con python-dotenv.try/except y lógica de reintento, tu aplicación caerá ante el primer pico de tráfico.Recursos gratuitos y comunidades para ir más allá del curso y mantenerte al día con DeepSeek y el ecosistema open-source de LLMs.

ollama run deepseek-r1:7b — arranca el modelo directamente en terminal.ollama list — muestra todos los modelos descargados en tu máquina.ollama pull deepseek-r1:1.5b — descarga la versión más ligera para pruebas rápidas.python -m venv venv && source venv/bin/activate (Linux/Mac) o venv\Scripts\activate (Windows) — activa el entorno virtual.chain.invoke({"input": "tu consulta"}) — forma estándar de ejecutar una cadena.Artículos publicados sobre DeepSeek Domina la herramienta de cero a producción

|

Por Ana Maria Gonzalez

DeepSeek y la Revolución de los Modelos de Lenguaje Open-Source La inteligencia artificial avanza rápidamente, y los modelos de lenguaje open-source como DeepSeek-R1 y DeepSeek-V3 se consolidan como herramientas clave para profesionales y empresas que buscan soluciones eficientes, personalizables y escalables. Estas plataformas permiten procesar grandes volúmenes de información y generar resultados precisos sin depender de modelos propietarios como GPT-4o o Claude. La adopción de DeepSeek facilita la automatización de tareas complejas, la generación de contenidos y la integración con aplicaciones web mediante APIs. Empresas tecnológicas y startups ya exploran estas herramientas para optimizar procesos internos, mejorar la experiencia del usuario y reducir costes operativos, mostrando que la IA open-source es hoy una ventaja competitiva tangible. En la práctica, desarrolladores y científicos de datos utilizan DeepSeek para personalizar modelos mediante técnicas de fine-tuning y ajustar la inferencia para tareas específicas. Esto permite a las empresas ofrecer soluciones más precisas, como chatbots inteligentes, asistentes virtuales y análisis predictivos adaptados a sus necesidades, mejorando la eficiencia y la calidad de los servicios. Además, la integración de DeepSeek con plataformas como Hugging Face, LangChain o Auto-GPT permite crear flujos de trabajo avanzados que combinan bases de datos externas y agentes autónomos. Esta tendencia de IA open-source en 2025 demuestra que la capacidad de personalización y escalabilidad ya no es exclusiva de grandes corporaciones, sino una oportunidad real para todo tipo de negocio. |

|---|

Formación bonificada online para empresas. Ayudamos a equipos a ganar productividad con formación realmente aprovechable.

Somos una empresa de formación bonificada especializada en formación online en sus diferentes modalidades: teleformación, aula virtual y formación mixta.

Ayudamos a nuestros clientes a alcanzar una mayor productividad mediante acciones formativas ajustadas a sus necesidades reales.

Formación que transforma equipos. Nos esforzamos por aportar valor: diseñamos itinerarios con objetivos concretos de negocio, medimos la finalización real, y acompañamos a cada alumno hasta el final. Por eso el 95% de quienes empiezan, terminan.