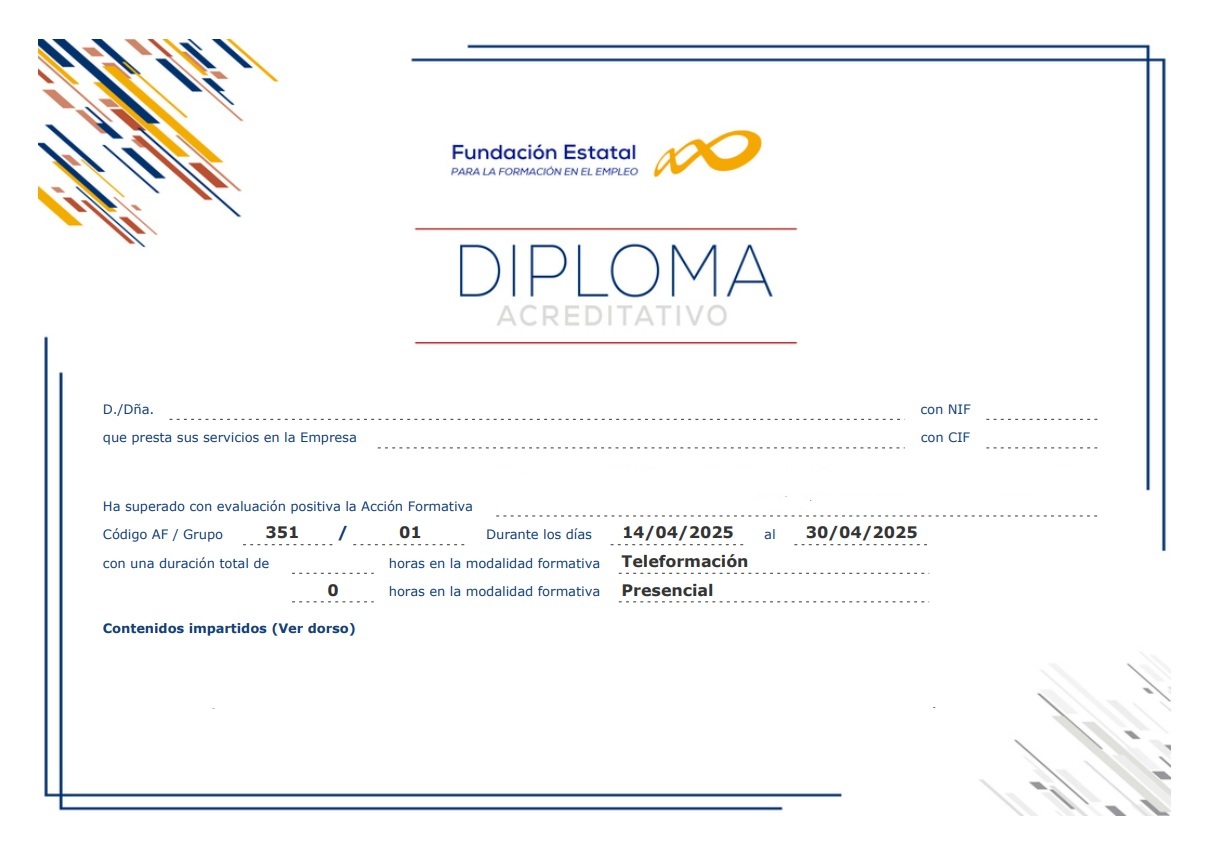

Diploma emitido por FUNDAE

+ Ampliar

+ Ampliar

🔍 Buscar curso

+5.000 cursos disponibles

Calendario: Flexible.

Calendario: Flexible.

Fecha disponible: Inmediata.

Fecha disponible: Inmediata.

Porcentaje de Bonificación: 100%

Porcentaje de Bonificación: 100%

Diploma acreditativo emitido por FUNDAE.

Diploma acreditativo emitido por FUNDAE.

Certificado acreditativo para concursos y oposiciones.

Certificado acreditativo para concursos y oposiciones.

Temario Personalizado.

Temario Personalizado.

Modalidades: teleformación, aula virtual y MIXTA

Modalidades: teleformación, aula virtual y MIXTA

| La duración del curso de IA Generativa con Python Hugging Face y Transformers fácil es de 50 horas,

acreditadas en el Diploma del mismo. PLAZO DE REALIZACIÓN: El plazo se puede establecer según las necesidades del alumno o del plan de formación de la empresa. |

| Este curso puede ser bonificado al 100% para la empresa receptora, incluso aunque esta tenga un porcentaje de copago en razón de su número de empleados en plantilla. El coste de la formación se recuperará

mediante descuento en el pago de los seguros sociales. |

Este descuento será aplicable libremente en cualquier mes del año posterior a la fecha en que haya finalizado la formación. Podrán bonificarse las matrículas de aquellos alumnos que realicen al menos el

75% del curso con éxito. |

| EN CURSOS ONLINE Teleformación: En esta modalidad todo el curso se realiza a través de internet, con acceso las 24 hs. todos los días de la semana y plazo máximo de seis meses. No hay actividades como clases a las que el alumno deba asistir en horarios y fechas programados. Aula virtual: En esta modalidad la formación se imparte mediante clases en directo a través de internet, es decir clases tele-presenciales, que se llevarán a cabo a través de ZOOM, Skype u otra herramienta a convenir. Modalidad MIXTA: Combinación de las dos modalidades anteriores. Los trabajadores asisten a clases en directo (por ejemplo una a la semana) y entre clases disponen de material para avanzar en el curso en la plataforma. Es la más completa para grupos de trabajadores que realizan un mismo curso. EN CURSOS PRESENCIALES o SEMI - PRESENCIALES En esta modalidad los trabajadores realizan el curso asistiendo físicamente a un aula en la que se imparte la formación. Puede ser complementada igualmente con acceso a una plataforma online entre clases. Para esta modalidad se requiere una consulta previa de disponibilidad en la ciudad donde se desee llevar a cabo. |

NOTA:

Trabajamos con la metodologia de curso personalizado, creada por Ciberaula en 1997. Usted puede solicitar un curso a la medida de sus objetivos, que combine lecciones de 2 o mas cursos en un plan de formacion a su medida. Si este es su caso consultenos, esta metodologia ofrece un aprovechamiento maximo de la formacion en los cursos bonificados para trabajadores.

El temario predefinido del curso online de IA Generativa con Python Hugging Face y Transformers fácil es el siguiente:

1 Introducción

1.1 Introducción

2 Hugging Face

2.1 Hugging Face

3 IA Generativa

3.1 IA Generativa

4 Transformers

4.1 Transformes y el mecanismo de atención - Parte I

4.2 Transformers y el mecanismo de atención - Parte 2

4.3 Transformers y el mecanismo de atención - Parte 3

4.4 Transformers y el mecanismo de atención - Parte 4

5 Evaluación de modelos IA

5.1 Evaluación de modelos IA

6 Pipelines

6.1 Pipelines

7 Aplicaciones prácticas de IA usando texto

7.1 Clasificación de Texto

7.2 Responder preguntas

7.3 Traducir Texto

7.4 Generación de Texto

8 Aplicaciones prácticas con imagen, video y audio

8.1 Generación de imágenes

8.2 Generación de Video

8.3 Generación de audio

9 Fine Tuning

9.1 Fine Tuning para generación de Texto

pip install jupyterlab — gratuito.pip install transformers — gratuita.pip install torch --index-url https://download.pytorch.org/whl/cpu — gratuito, sin necesidad de GPU.pip y abrir una terminal es suficiente.A lo largo del curso construyes aplicaciones reales con Hugging Face y Python. Estos son los proyectos principales que desarrollarás:

Estos son los tropiezos más frecuentes al empezar con Hugging Face y Transformers en Python. Conocerlos de antemano te ahorra horas de depuración:

transformers a nivel global y luego el proyecto no encuentra el paquete o hay conflictos de versiones. Activa siempre el venv primero.distilbert, gpt2, t5-small) hasta que necesites más potencia.pipeline() dentro de un bucle recarga el modelo en cada iteración. Cárgalo una sola vez fuera del bucle..env excluido con .gitignore.truncation=True en tokenización: los modelos tienen longitud máxima de secuencia; no truncar provoca errores de dimensión o resultados incorrectos silenciosos.pipeline() o model.eval().device_map="auto" ni especificar dispositivo: en máquinas sin GPU el modelo puede intentar usar CUDA y fallar. Fuerza CPU con device=-1 en el pipeline si no tienes GPU disponible.Recursos gratuitos y herramientas que complementan el curso y te acompañarán mucho después de terminarlo:

pip install gradio): crea interfaces web para tus modelos en 5 líneas de código..gitignore correcto para proyectos Python.huggingface-transformers y python: resuelve errores concretos.Artículos publicados sobre IA Generativa con Python Hugging Face y Transformers fácil

|

Por Ana Maria Gonzalez

IA Generativa y Transformers: el nuevo motor de innovación en 2025 La IA generativa se ha consolidado en 2025 como una de las tecnologías más influyentes para empresas y profesionales de todo el mundo. Con el apoyo de plataformas como Hugging Face y librerías de Transformers, es posible crear modelos capaces de generar texto, imágenes y datos sintéticos que agilizan procesos y ofrecen nuevas formas de innovación en sectores tan diversos como la educación, la salud y el marketing. Uno de los mayores beneficios de esta tecnología es la democratización del acceso. Gracias a entornos como Google Colab, cualquier persona con conexión a internet puede entrenar y personalizar modelos avanzados sin necesidad de infraestructuras costosas. Esta accesibilidad ha permitido que pymes, startups y profesionales independientes adopten la IA generativa como una herramienta competitiva en sus proyectos. En el ámbito empresarial, los modelos de lenguaje basados en Transformers ya están siendo aplicados en atención al cliente, automatización de reportes y creación de contenido. Grandes compañías tecnológicas han marcado el camino, pero cada vez más empresas medianas aprovechan estas soluciones para optimizar costes y mejorar la productividad. El impacto de la IA generativa también se percibe en la forma de trabajar. Profesionales de sectores no técnicos, como el periodismo o la investigación, utilizan modelos preentrenados para procesar información de manera más rápida y precisa. Esta tendencia refleja un futuro en el que las habilidades en Python y el manejo de Hugging Face se convierten en competencias esenciales para enfrentar los retos de la transformación digital. |

|---|

Formación bonificada online para empresas. Ayudamos a equipos a ganar productividad con formación realmente aprovechable.

Somos una empresa de formación bonificada especializada en formación online en sus diferentes modalidades: teleformación, aula virtual y formación mixta.

Ayudamos a nuestros clientes a alcanzar una mayor productividad mediante acciones formativas ajustadas a sus necesidades reales.

Formación que transforma equipos. Nos esforzamos por aportar valor: diseñamos itinerarios con objetivos concretos de negocio, medimos la finalización real, y acompañamos a cada alumno hasta el final. Por eso el 95% de quienes empiezan, terminan.